NVIDIA DGX Spark Founders Edition: een Gamechanger voor AI en Offensive Security

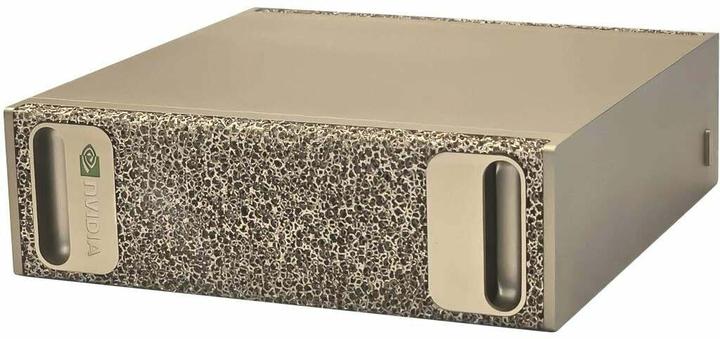

Met de introductie van grootschalige AI-modellen is de vraag naar high-performance rekenkracht exponentieel gegroeid. Dat zien we o.a. aan de prijzen van RAM en VRAM. Voor AI-onderzoek, deep learning-training en performance-intensieve workloads zijn traditionele GPU-gebaseerde systemen al snel te mager. Toch knap als je ziet wat voor kwaliteit ze kunnen verwerken in gaming. Dat zegt al heel wat over de rekenkracht die nodig is om een (groot) AI model te draaien met een relatief goede performance. De NVIDIA DGX Spark Founders Edition is ontworpen om die grenzen aanzienlijk op te rekken! De NVIDIA DGX Spark biedt een solide fundament voor next-generation AI-onderzoek. Ik heb dit platform recent aangeschaft en gebruik het intensief voor onderzoek en training, met name in de offensive security hoek. In dit artikel leg ik uit wat dit apparaat precies is, waarom het relevant is voor mijn werk.

Wat is de NVIDIA DGX Spark Founders Edition?

De NVIDIA DGX Spark Founders Edition is onderdeel van NVIDIA’s DGX-platformfamilie, een reeks systemen die specifiek zijn gebouwd voor AI-workloads, deep learning-training en high-performance computing (HPC). Waar reguliere GPU-servers vaak bestaan uit losse GPU’s die via PCIe met de CPU en elkaar communiceren, is een DGX-systeem ontworpen als een geoptimaliseerde, volledig geïntegreerde AI-engine. Dit betekent:

- Hoge bandbreedte tussen CPU, GPU’s en geheugen

- Snelle interconnects (zoals NVLink en high-speed fabric) voor GPU-naar-GPU communicatie

- Geoptimaliseerde softwarestack (drivers, CUDA, cuDNN, cuTENSOR, TensorRT, Triton)

- Enterprise-klare managementtools en ondersteuning voor frameworks zoals PyTorch, TensorFlow en JAX

De DGX Spark Founders Edition combineert krachtige hardware met software-optimalisaties waardoor je modellen sneller kunt trainen en experimenten op schaal kunt uitvoeren.

Waarom deze machine relevant is voor AI-onderzoek

In deep learning en generative AI draait alles om schaal:

Schaalbare training van grote modellen

Modellen zoals GPT-achtige netwerken, vision transformers of andere generatieve netwerken vereisen veel rekenkracht. Kleine GPU’s of consumer-kaarten halen dit niet efficiënt. De DGX-serie:

- biedt veel GPU-cores

- hoge bandbreedte

- parallelle rekenkracht

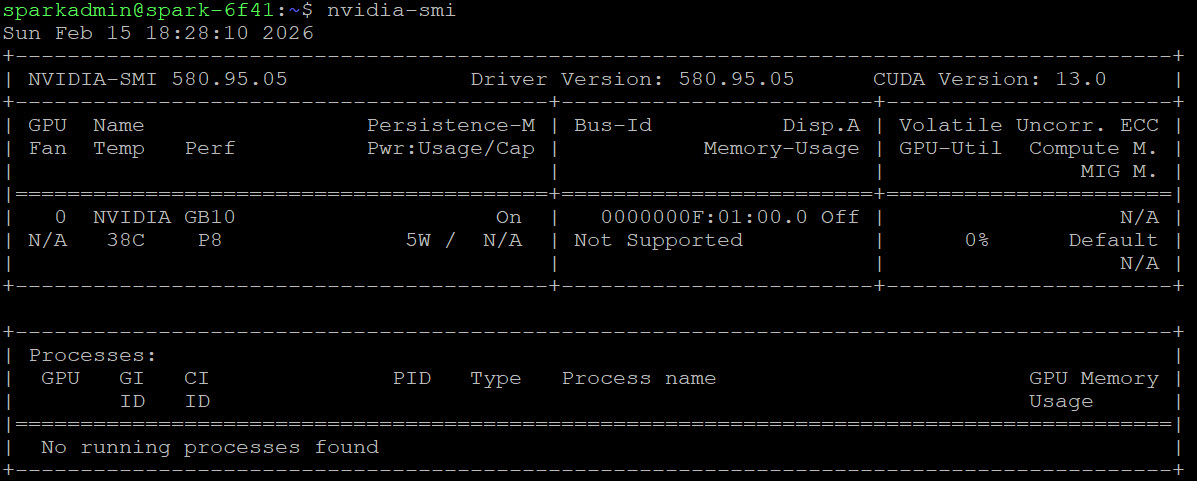

Even wat technische specificaties op een rijtje:

- Superchip: NVIDIA GB10 Grace Blackwell

- CPU: 20-core ARM processor (10× Cortex-X925 high-performance cores & 10× Cortex-A725 efficiency cores)

- Architectuur: ARMv9.2

- AI Performance: ~1 PFLOP (1,000 TOPS) bij FP4 met sparsity ondersteuning

- Unified System Memory: 128 GB LPDDR5x (gedeeld tussen CPU en GPU)

- GPU Architectuur: NVIDIA Blackwell-generatie

- Tensor Cores: 5e generatie

- RT Cores: 4e generatie

- CUDA cores: Blackwell-generatie (exact aantal niet altijd publiek, maar ontwerp uit dezelfde GPU-family)

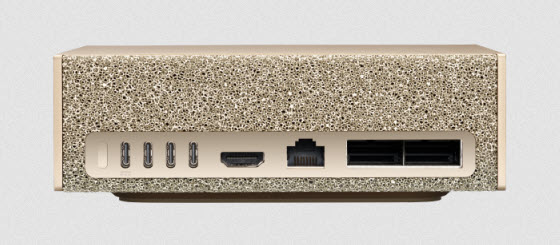

- Interne SSD: 4 TB NVMe M.2 SSD

- OS: NVIDIA DGX OS (Ubuntu-gebaseerd met NVIDIA AI-tooling)

De DGX Spark is ontworpen als desktop AI-supercomputer voor lokaal AI-onderzoek, training en inferentie. Hij combineert CPU- en GPU-kracht in één geïntegreerde GB10 Grace Blackwell Superchip, met een grote gedeelde geheugencapaciteit om grote modellen te hosten zonder omvangrijke cluster-infrastructuur.

Dit maakt het mogelijk om modellen effectief te trainen op datasets die variëren van miljoenen tot miljarden tokens of beelden.

Realistische performance voor onderzoek

In een onderzoeksomgeving wil je:

- iteraties snel doorlopen

- hyperparameters* testen

- meerdere experimenten parallel draaien

*Hyperparameters zijn configuratiewaarden die bepalen hoe een machine learning-model wordt getraind, maar die niet automatisch door het model zelf worden geleerd. Ze beïnvloeden het leerproces, de snelheid van convergentie en de uiteindelijke prestaties. Voorbeelden zijn de learning rate, batch size, aantal lagen, aantal neuronen, en het aantal trainingsstappen (epochs).

Op een traditioneel systeem zijn deze experimenten traag en gefragmenteerd. Op de DGX Spark zijn de iteraties veel sneller, wat de productiviteit direct verhoogt.

Toepassingen in offensive security

Maar wat doet dit AI-krachtwerk in het domein van offensive security? AI raakt steeds meer verwezen met uiteenlopende computergestuurde taken, zo ook in de cybersecurity. Dit telt zowel voor de aanvallende als voor de verdedigende kant. Aangezien we in de aanvallende kant al veel gebruik zien van AI kan de verdedigende kant niet achterblijven. We kunnen dus als pentesters leren hoe AI ons kan ondersteunen om zodoende onze klanten te blijven beschermen en de defensieve kant te versterken. Denk o.a. aan:

Model based threat simulation

Je kunt AI-modellen trainen om:

- Threat actor-gedrag te simuleren

- Complexe aanvalspatronen te genereren

- Automatisch exploit-generation of fuzzing pipelines te ondersteunen

Dit werk vereist grote datasets en snelle iteraties, precies waarin de DGX-systemen uitblinken.

Generative Models voor tool-ontwikkeling

In red teaming en offensive tooling wil je bijvoorbeeld:

- Automatische script-generatie

- Geavanceerde protocol simulatie

- Context-bewuste payload creatie

- Attack chains testen

Modellen zoals GPT kunnen worden aangepast (finetuned) voor dit doel, maar alleen als je de rekenkracht hebt om dit zinvol te doen.

Security analysis en audit automatisering

AI kan helpen bij:

- Automatisch code-analyse

- Vulnerability detection

- Pattern detection in log data

- Betere hunting queries genereren

- Beter cybersecurity advies

Zeker wanneer je grote hoeveelheden data wilt analyseren (bijvoorbeeld netwerkdata, logs, telemetry), wordt traditionele CPU-analyse langzaam. GPU-versnelde pipelines versnellen dit enorm.

Quantization, Inference en local deployment

Naast training speelt inference (het gebruiken van een getraind model om voorspellingen te doen op nieuwe input) een belangrijke rol:

- Quantization maakt het mogelijk om modellen efficiënter te draaien met minimale performance-verlies.

- Voor lokale security-agents, red team tools en offline AI-werk is dit cruciaal.

De DGX Spark maakt het ook mogelijk om:

- Modellen efficiënt te quantiseren en te optimaliseren

- Inference workloads lokaal te draaien in ontwikkeling of test-environments

- Performance-verschillen te meten tussen verschillende optimalisaties

Kortom: niet alleen training, maar ook inference-optimalisatie profiteert enorm van de hardware-capabilities.

Meerwaarde voor mij (Jarno Baselier Cybersecurity)

De Nvidia DGX Spark Founders Edition is niet goedkoop. Je betaald al snel tussen de 4000 en 5000 euro als het apparaat al leverbaar is. Daarnaast gaan de ontwikkelingen zo snel dat er over een jaar weer betere alternatieven zijn. Dus wat maakt deze investering nu echt waardevol?

Praktijkgerichte AI-experimenten

Tijdens de ontwikkeling van mijn “AI Red Team Academy” (https://jarnobaselier.nl/ai-red-team-academy/) course wilde ik snelheid om zaken te kunnen testen. Daarnaast wil ik AI inplementeren op diverse vlakken waar ze mijn werk makkelijker maken. Denk hierbij aan het uitvoeren van diverse taken of het uitvoeren van volledige attack-chains. Daarnaast wil ik data van klanten nooit naar de “cloud” modellen uploaden en alles lokaal houden. De DGX Spark maakt het o.a. mogelijk om:

- Modellen vanaf de grond te trainen

- Eigen cybersecurity gerelateerde modellen bouwen

- Experimenteren met generative capabilities in een veilige, lokale omgeving

Diepere security-analyses

Security-onderzoek vraagt vaak om:

- Grote datasets

- Simulaties op grote schaal

- Volledige controle over omgeving en tooling

Een DGX biedt deze schaal en controle, iets wat cloud-instances vaak duur en lastig reproduceerbaar maken, zeker als gevoelige data zoals klantendata betrokken is.

Efficiënte iteratie en onderwijs

Of je nu zelf leert, cursussen ontwikkelt of lesgeeft m.b.t. AI, snelheid is altijd cruciaal. Snelle iteraties maken experimenten herhaalbaar en betrouwbare conclusies mogelijk, iets datessentieel is voor red team training.

Praktische ervaringen en inzichten

In de eerste weken met de DGX Spark werd al snel duidelijk hoeveel impact hardware-capabilities hebben op het onderzoeksproces:

- Iteratiesnelheid: waar trainingsruns vroeger minuten of uren duurden op consumer-GPU’s, is dit nu binnen seconden tot minuten haalbaar.

- Model-evaluatie: door de hardware kun je meerdere checkpoints tegelijk evalueren.

- Experimentele vrijheid: geen kostenangst voor cloud-GPU-tijd betekent dat je kunt werken met grotere context lengths en completere datasets

- …en met meer varianten (lokaal) experimenten kunt doen

Dat is wat echte exploratie mogelijk maakt.

Tot slot

De NVIDIA DGX Spark Founders Edition is meer dan alleen een krachtig stukje hardware. Het is een productiviteitsversterker, een versneller van onderzoek, en een strategisch instrument binnen offensive security, onderwijs en praktische AI-toepassingen. Voor mij betekent dit dat de grenzen van wat je kunt bouwen, meten en analyseren worden verlegd van conceptueel begrip naar daadwerkelijke expertise. Met deze machine heb je niet alleen rekenkracht, maar ook de mogelijkheid om complexe real-world AI-security vraagstukken op te lossen zonder concessies te hoeven doen aan schaal of performance. En daarnaast is hij ook relatief goed in het kraken van wachtwoord hashes 😉